文章图片

智东西

作者 | 陈骏达

编辑 | 漠影

起猛了 , AI现在都能生成武打戏了 , 还是人虎搏斗的那种!

近日 , 一条名为《风入松》的AI短片 , 在年度AI盛会WAIC期间亮相 , 吸引了不少眼球 。 这部影片以现代废土风 , 重新演绎了经典的“武松打虎”故事 。

AI短片《风入松》

《风入松》由中国电影导演中心与中国电信人工智能研究院(TeleAI)联手打造 , 使用的正是TeleAI的VAST视频生成大模型 。

TeleAI由中国电信集团CTO、首席科学家李学龙教授牵头组建 , 于去年7月的WAIC大会上正式揭牌 。 在李学龙教授的带领下 , TeleAI团队打造了包括VAST在内的星辰大模型体系 , 是国内首个全模态、全尺寸、全国产的“三全”大模型 , 并推动相关技术的创新和应用 。

从设定的角度来看 , 《风入松》这部短片本身便极具想象力 , 但最令人惊叹的 , 当属AI技术如何将天马行空的想象化为逼真画面 。

作为技术支撑 , TeleAI的VAST视频生成大模型去年12月发布时 , 便在权威视频生成评测榜单VBench中夺得榜首 , 并持续迭代升级 。

从基础画面生成 , 到复杂动作 , 再到镜头控制与角色一致性优化 , 其能力边界不断扩展 , 已具备在专业创作场景中“顶上阵”的潜力 。

一、视频生成告别开盲盒游戏 , 能演会拍才是好AI要真正理解《风入松》这部短片实现的突破 , 我们首先得看看 , 影视制作究竟需要什么样的AI工具 。

分辨率高、动作流畅、细节写实 , 这些只是技术层面的基础能力 , 远远不够支撑一部真正意义上的影视作品 。

要在真实的影视制作流程中发挥作用 , AI更关键的是要理解导演的创作意图 , 跟上叙事节奏、掌握镜头语言、调动情绪氛围 , 真正融入视听语言的表达体系 。

换言之 , AI不仅要会画画 , 更要像电影人一样会拍、会演 , 能够协同完成角色塑造、场景调度与叙事推进 , 成为一名具备视听表达能力的“创作伙伴” 。

《风入松》中 , TeleAI 的VAST视频生成大模型已展现出强烈的画面表现力和叙事控制力 。

影片伊始 , 当现代“武松”骑着摩托车在沙漠飞驰 , AI将每一处细节都刻画得淋漓尽致:引擎轰鸣声与风沙的呼啸形成震撼音浪 , 摩托车飞跃障碍时在空中划出完美的弧线 , 车轮驶过沙地时激起细腻的沙浪 , 光影真实自然 。

在激烈的猛虎搏斗场景中 , AI模拟的每一根虎毛都随动作摆动 , 肌肉线条在扑咬时展现出惊人的动态细节;主角与老虎搏斗时拳拳到肉 , 动作有力、毫无穿帮 。 这些曾需要顶级特效团队数月打磨的画面 , 如今通过AI实现了电影级的真实感 。

TeleAI视频生成大模型已经凭借其影片质量 , 俘获了一批专业人士 。 参与《风入松》制作的团队在影视行业有丰富的从业经验 , 据了解 , 他们在使用TeleAI视频生成大模型后 , 给予了高度认可 , 这更凸显了TeleAI在视频生成领域实现的重大突破 。

二、如何打造电影级视频生成模型?揭秘背后三项核心技术那么 , 打造这样一款视频生成大模型 , 背后究竟需要哪些关键支撑?从《风入松》的画面中 , 我们可以清晰地看到其中的三项核心技术 。

首先是动作迁移技术 。 在《风入松》这部短片中 , TeleAI的VAST视频生成大模型展现出强大的画面表现力和叙事控制力 。 张力十足的打斗戏中 , 没有出现“穿模”、扭曲等常见问题 。

动作迁移技术允许制作者上传一张首帧图和一段参考动作 , AI便能让首帧图中人物的动作表演与参考视频完全一致 。 这一技术成功攻克了AI生成视频中动作节奏难以控制、人物表情表演生硬等难题 , 让AI生成的视频人物动作更自然、表情更生动 。

业界的主流动作迁移方案都基于骨骼绑定 , 不过 , TeleAI决定更上一层楼 , 将其从2D骨骼点升级为3D骨骼点绑定 , 使得动作更具空间感、层次感 , 甚至可以自然地控制动物或卡通人物 。

另一大核心技术为可控三维运镜 , 赋予了AI对“镜头语言”的准确理解和运用能力 。 例如 , 在下方画面短短的几秒内 , 《风入松》呈现了多角度、快速切换的复杂运镜 , 远景、仰拍、特写等流畅衔接 。 这些原本需要专业摄影指导和团队配合的镜头切换 , 在这里被AI准确实现 。

这并不是靠堆砌提示词“蒙”出来的 。 通过可控三维运镜技术 , TeleAI把三维重建与视频生成深度融合 , 赋予模型空间结构的感知能力 , 再通过摄像机内参、外参等物理参数精细控制运镜效果 。 AI不只是懂内容 , 它逐渐开始懂得怎么拍 , 让AI真正具备导演般的视角 。

会演、会拍仅仅是开始 , 很多业内人士评价 , AI视频目前最大的问题之一是“一致性差” , 同一人物在不同镜头中的形象、着装、气质常常前后不一 , 极易穿帮 。

但《风入松》中的主角却始终保持了稳定的外貌风格 , 这得益于背后的人物一致性技术 。 TeleAI 的VAST视频生成大模型采用分步生成的方式 , 先生成分镜、深度信息等中间数据 , 再在此基础上精细生成画面 。

这种生成流程极大提高了人物、画面的一致性与叙事可控性 , 流程和电影工业中用故事板搭建画面框架 , 再利用计算机图形技术渲染的逻辑几乎一致 , 让AI没有随意发挥的空间 。

上述底层能力的升级 , 是AI视频真正迈入影视工业体系的敲门砖 。 更重要的是 , TeleAI在与专业导演的合作中 , 获得了大量来自一线实践的反馈需求:比如演员的表情、情绪、人物节奏等更加细腻的表演控制 。 这些开发者原本没有预料到的专业需求 , 正逐渐转化为技术研发的新方向 。 凭借这些先进技术 , TeleAI为影视制作行业带来了前所未有的便利和优势 。

三、视频生成+通信解锁新场景 , “脑补”画面实现远洋视频通话在推动视频生成技术赋能影视工业的同时 , TeleAI也在积极探索这项技术更广阔的应用场景 。 毕竟 , 视频生成的本质并不仅限于电影创作 , 而是一种对视觉信息的重构方式 。

从AI的通用视角来看 , “智能的本质是压缩”已成为业内共识 。 无论是语言模型、图像模型还是视频模型 , 其核心任务都是从海量原始数据中提取模式与规律 , 并以高效、紧凑的方式编码进模型参数中 , 模型学会用有限的参数表示无限的可能 。

但真正的智能不仅在于压缩 , 更在于“还原” 。 也就是说 , 一个具备高水平智能的系统 , 必须能够在接收有限信息的情况下 , 准确重建原始内容 , 甚至完成合理补全与未来预测 。

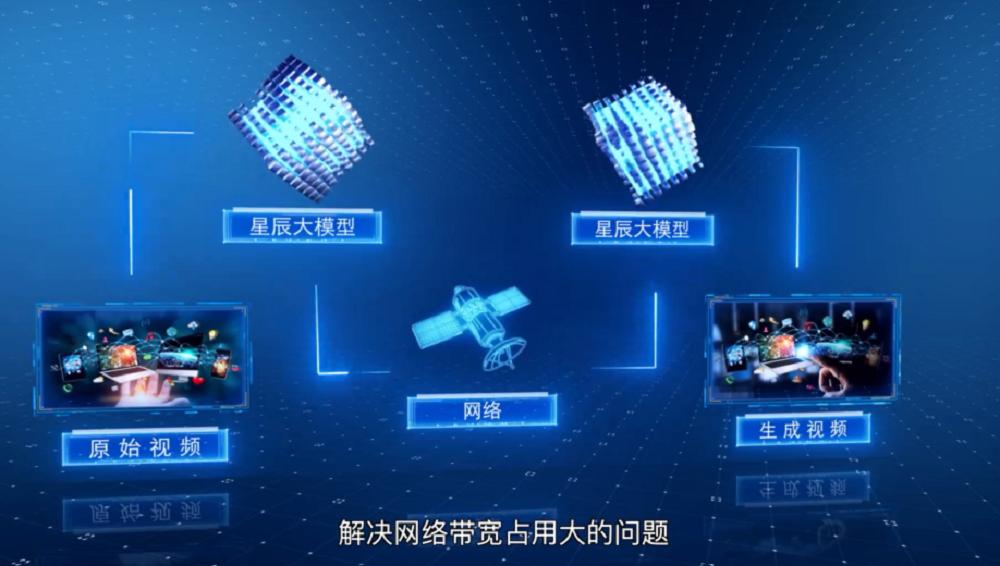

中国电信人工智能研究院(TeleAI)将VAST视频生成大模型与其正在布局和研究的一项重要技术“智传网(AI Flow)”深度结合 , 提出了一种新型通信技术——生成式智能传输 , 也就是用“计算”换“带宽” 。

智传网(AI Flow)是人工智能(智)、通信(传)、网络(网)三项关键技术的融合 , 通过网络分层架构 , 基于连接与交互 , 能够实现智能的传递和涌现 。

在李学龙教授的带领下 , TeleAI打造了包括智传网(AI Flow)技术体系(包括生成式智能通信技术等)在内的 “一治+三智”战略科研布局 , 其他方向还包括AI治理、智能光电(包括具身智能)、智能体 。

智传网(AI Flow)的突破 , 有望解决通信业务中一个长期存在的难题——如何在极其有限的带宽条件下 , 高效传输高质量的视频和多媒体内容 。

这是困扰通信行业多年的技术瓶颈——传统的视频通信技术依赖高带宽和高稳定性的网络环境 , 一旦网络不给力 , 立刻就卡成PPT、音画不同步 。

像你我这样的普通用户 , 也经常会在生活中遇到类似问题 。 例如 , 在演唱会、会展等人员极为密集的场所 , 网络拥堵常常导致视频通话无法连接、直播卡顿 , 甚至连基本的视频上传和下载都变得困难 。

更不用说在高铁、地下、飞机或远洋、偏远山区等极端条件下 , 视频通信几乎成为奢望 。 这些问题背后 , 正是现有通信技术在带宽、稳定性和数据传输效率上的瓶颈 。

在本届WAIC大会上 , TeleAI展示了基于智传网(AI Flow)的生成式智能传输技术的典型案例——远洋通信 , 破解了这一瓶颈 。

船舶与陆地的通信 , 长期以来是全球航海技术发展中的巨大挑战 。 由于船上的卫星网很慢 , 信号很差 , 船员只能通过微信打字给家里报平安 , 无法进行视频电话或刷短视频、上视频网站 。

通过生成式智能传输技术 , 让远洋视频通话不再是奢望 , 它将变得简单而高效 。 这项技术的应用 , 不仅连通了海洋与陆地 , 也让船员们的业余时光告别了单调 , 拥有如同岸上般丰富的色彩 。

传统视频压缩传输方式是把整段视频原样搬运 , 而生成式智能传输技术则采用了更聪明的办法:通过TeleAI的多模态大模型 , 提取音视频最关键的特征信息 , 压缩编码后 , 将这些信息发送给接收端 。

而在接收端 , TeleAI部署在本地的多模态生成大模型能根据上述信息 , 自主“脑补”出完整画面 , 就像用草图还原一副画作一样 。

这种压缩传输方式相较传统方案(如H.264+5G LDPC)展现出明显优势 。 在卫星场景下带宽资源稀缺时 , 这个方案将带宽需求压缩了整整1-2个数量级 , 视频数据体积最多可降至原始的1% , 在背景变化较小的场景中甚至可达千分之一 。

在船载服务器上的多模态生成大模型本地完成音视频的智能还原后 , 画质、音质可以保持“主观无损”的水平 。 这就让远洋海员们即便在极低带宽条件下 , 依然能够实现清晰、流畅的视频通话体验 。

从部署角度来看 , 这项技术对硬件要求也非常友好——船只仅需搭载一台配有4张消费级显卡的本地服务器 , 便可为船员提供稳定的Wi-Fi视频通话服务 。 这种轻量化部署 , 为未来的规模化落地提供了现实基础 。

生成式智能传输不仅适用于远洋通信 , 还是一整套可适配不同通信环境的解决方案 。 系统可根据不同场景下的带宽、算力等资源条件 , 智能选择不同大小的视频解码模型 。

例如 , 在多数通话场景中 , 仅使用480P分辨率和小模型即可实现流畅且清晰的通信体验 , 从而实现算力与带宽的最优协同 。

可以说 , 这项技术展现的并非某一项技术的单点突破 , 而是一种系统性的融合式创新 。 如果没有VAST视频生成技术的日益成熟 , 视频信号根本压缩不到这个程度;如果没有智传网(AI Flow)基础构建 , 再精美的画面也送不到用户眼前 。

未来 , 通信不再是单纯的信号搬运 , 而是理解与重建的过程 , 编码的不再是比特 , 而是意义本身 。 生成式智能传输技术在远洋通信的应用场景中已获得验证 , 在不久的未来 , 这项技术将进一步推广 , 实现在飞机的机舱内拨打高清视频会议 , 不因信号影响工作;野外露营时 , 也能收看精彩的球赛 , 不为生活留下遗憾 。

【国产视频生成再突破!从影视级短片到远洋亲情连线,AI让天涯变咫尺】这正是一场AI与通信的“双向奔赴” , 也为构建高质量、低成本的未来多媒体通信基础设施 , 提供了坚实的技术底座与实践范本 。

推荐阅读

- 镶钻小折叠,让我们想起了国产手机的“至暗时刻”

- 这个5亿播放的AI视频,邪乎得平平无奇

- B站持续完善海外用户产品体验,用户可体验原汁原味多语种视频

- 全国产智能体MasterAgent:一句话造专属AI团队,专业协同交付

- 美国麻烦了,中国CPU国产率超20%,GPU国产率超30%了

- 无惧封禁!Cursor最佳国产平替诞生,彻底告别代码泄露风险

- 苹果官方账号误传三星Galaxy Z Flip7宣传视频?微博背锅

- 全国产化替代?华为Mate80系列“亮了”

- 中国智能手机畅销榜更新:红米K80至尊版排名第9,国产新黑马诞生

- 国产突破!人形机器人核心部件国产化率超七成!