文章图片

文章图片

NVIDIA宣布了专门用于大规模上下文处理的Rubin CPX , 同时披露了新一代AI服务器 , 规模和性能实现了大幅度的跃升 。

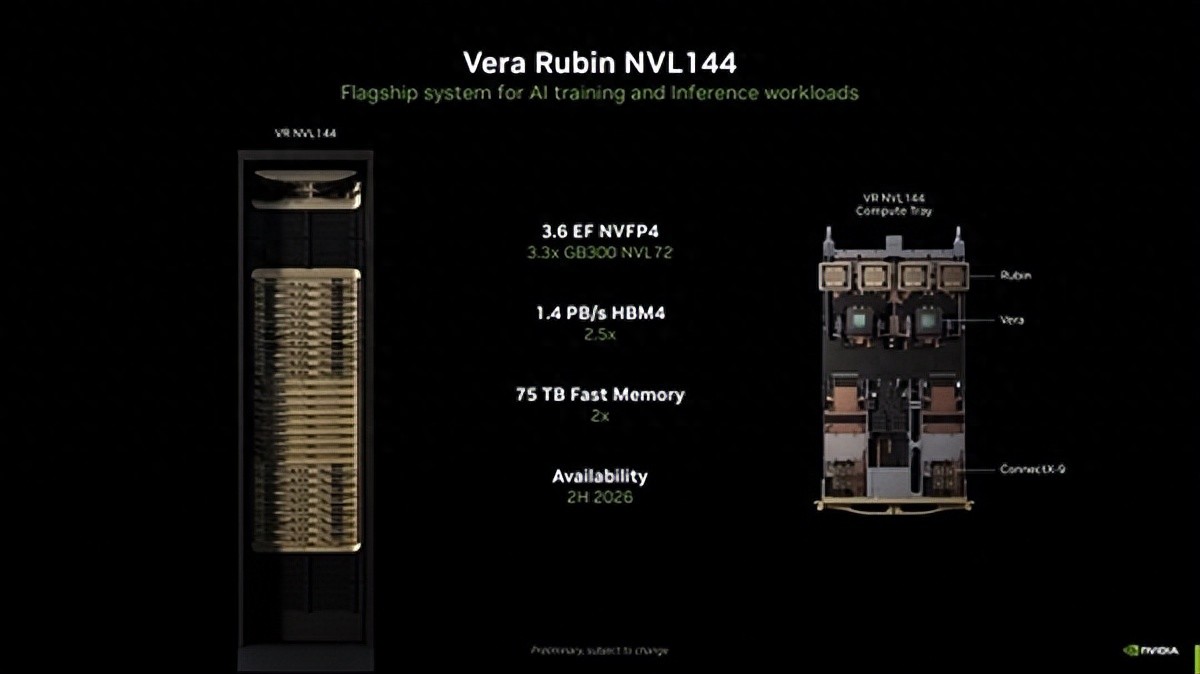

“Vera Rubin NVL144”定位于AI训练与推理用途的旗舰产品 , 应该每个机架配备36颗Vera CPU、144颗Rubin GPU , 同时搭配1.4PB/s超高带宽的HBM4(容量没说) , 以及多达75TB存储 。

算力性能在NVFP4数据精度下可高达3.5 EFlops , 也就是每秒350亿亿次 , 对比GB300 NVL72提升3.3倍!

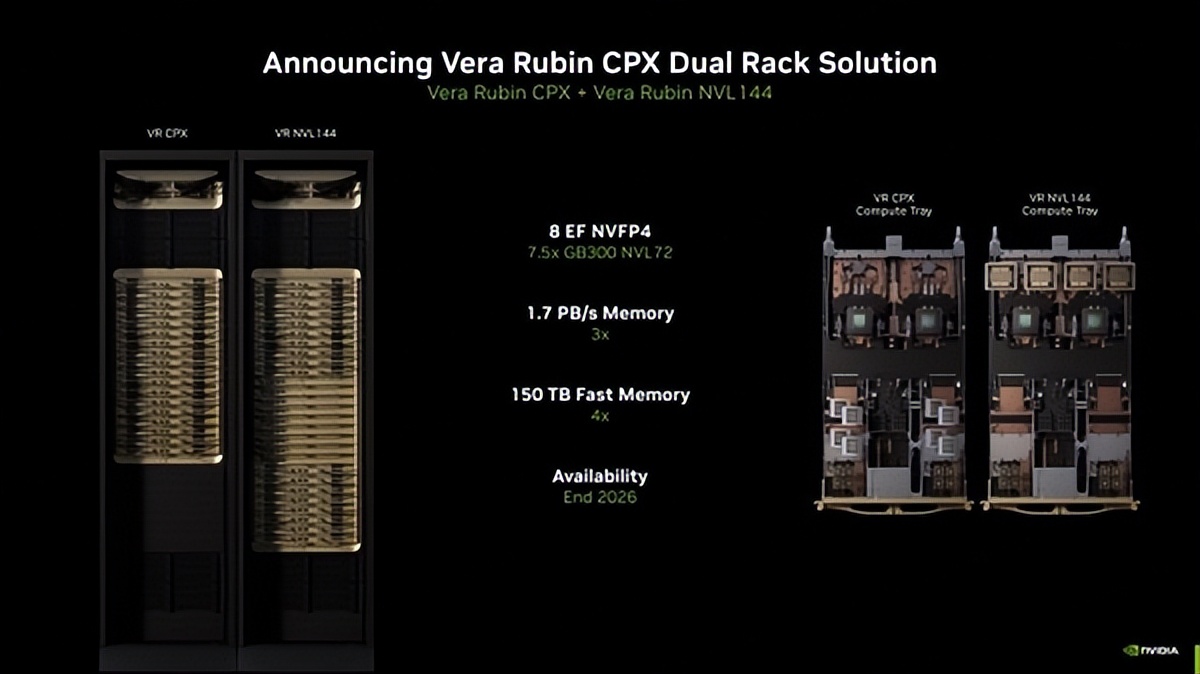

“Vera Rubin NVL144 CPX”又加入了72颗Rubin CPX , 组成了单个机架144颗GPU、36颗CPU的庞大规模 。

【NVIDIA宣布下代AI服务器:288颗GPU+36颗CPU 800亿亿次每秒】同时 , 它还有1.7PB/s带宽的HBM4内存、100TB高速存储 , 以及Quantum-X800 InfiniBand或者Spectrum-X以太网 , 搭配ConnectX-9 NIC网卡 。

整机算力在NVFP4下达到了惊人的8 EFlops , 即每秒800亿亿次 , 对比GB300 NVL72提升了7.5倍 。

如果有需要 , 可以将两台服务器组合在一起 , 配置和算力直接翻倍 。

NVIDIA号称 , 有了这样的AI服务器 , 每投入1亿美元 , 就可以换来50亿美元的收获 。

NVIDIA最新公布的路线图显示 , Rubin GPU和相关系统将在2026年底开始登场 , 2027年推出升级版Rubin Ultra , 2028年则是全新的再下一代Feyman GPU , 继续搭配Vera CPU 。

推荐阅读

- NVIDIA突然官宣下代新GPU!多达128GB显存

- 针锋相对!美团宣布大众点评“重启”品质外卖,C端AI智能体即将发布

- 后摄神似小米15!魅族22官宣定档,一周后见

- 三星新品官宣:9月16日,正式发售

- 华为新品官宣:9月12日,全面开售

- 小米新品官宣:9月15日,正式开售

- OPPO新机官宣:9月12日,正式开售

- 9月又一款新机官宣:9月16日,全新发布

- 魅族新一代旗舰机官宣:9月15日,正式发布

- 苹果新品官宣:9月10日,全新发布